Hablar sobre cómo hacer un detector de mentiras con Claude puede llevar a un error de enfoque, en vista de que Claude no detecta engaños humanos como si leyera intenciones.

En este sentido, lo que sí puede hacer es revisar consistencia, buscar contradicciones, señalar vacíos y explicar qué tan sólida parece una afirmación. Ese uso resulta práctico para tareas, artículos, documentos y código.

¿Qué significa realmente usar Claude como detector de mentiras y para qué sirve?

La base del sistema de Claude es el prompt, que se trata de una instrucción que orienta la respuesta del modelo.

Si defines objetivo, criterio y formato, la revisión mejora mucho. Anthropic recomienda claridad, ejemplos y estructura explícita en sus mejores prácticas de prompting.

Así pues, usar Claude de esta forma significa pedirle una auditoría de afirmaciones, no un juicio absoluto de verdad. Su función es separar hechos, inferencias y opiniones, además de indicar qué parte está respaldada y cuál necesita prueba adicional. Esa distinción evita confiar en respuestas solamente porque suenan convincentes.

Esta sirve para realizar algunas de las siguientes acciones:

- Revisar resúmenes, argumentos, comparativas, documentación técnica y explicaciones complejas.

- Ayuda a detectar frases demasiado seguras o estadísticas sin respaldo.

Para entender mejor este entorno, conviene repasar los tipos de IA generativa y el modo en que producen texto y código.

¿Cómo configurar el prompt inicial para que Claude contraste datos, señale dudas y explique su nivel de certeza?

Lo más útil es asignarle a Claude un rol claro, tal como, por ejemplo, “verificador” o “auditor lógico”.

Después, debes pedirle acciones concretas como separar afirmaciones, pedir evidencia, marcar contradicciones y expresar nivel de certeza. Anthropic insiste en que las instrucciones claras y bien organizadas elevan la calidad de la salida.

En la práctica, cómo hacer un detector de mentiras con Claude empieza por un prompt base como este:

Analiza el texto como verificador. Separa hechos, inferencias y opiniones. Marca qué afirmaciones tienen apoyo, cuáles requieren fuente y cuáles parecen débiles. Explica tu nivel de certeza como alto, medio o bajo. Si no tienes base suficiente, indícalo.

Si además trabajas de forma recurrente con IA, los cursos de IA ayudan a convertir prompts aislados en procesos estables.

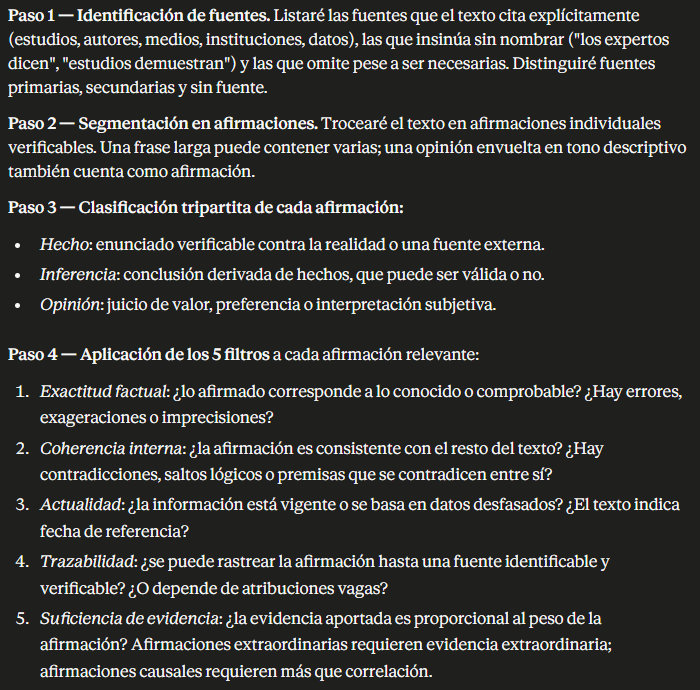

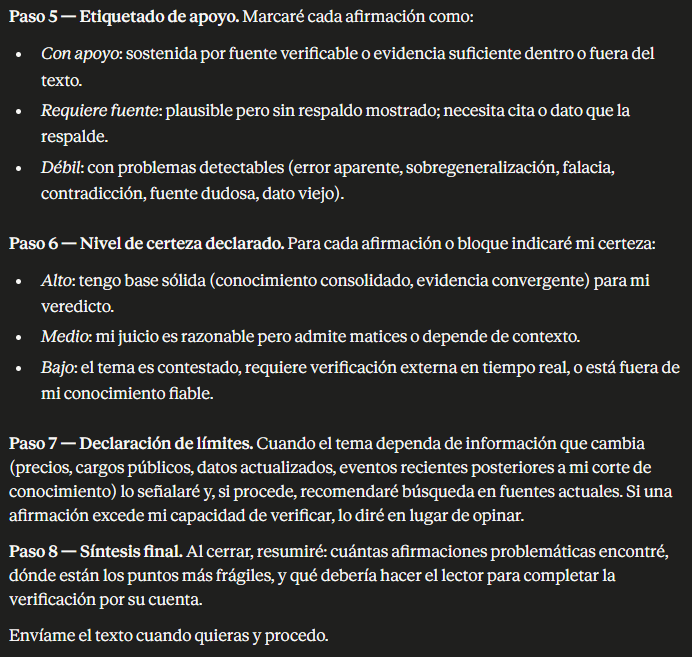

Paso a paso para crear un flujo de verificación con Claude

Un flujo útil funciona por etapas. Primero se fija qué quieres comprobar. Luego se define la evidencia aceptable. Después se revisa por capas.

Fuentes

Fuente primaria significa documento original u organismo oficial que respalda un dato. Pide a Claude que priorice normas, manuales, documentación técnica o textos académicos según el caso.

Si tu versión incluye Research, puede encadenar búsquedas y devolver citas revisables, algo útil para información reciente.

Criterios

Criterio de revisión significa regla para aceptar, dudar o rechazar una afirmación. Usa 5 filtros, los cuales son exactitud factual, coherencia interna, actualidad, trazabilidad y suficiencia de evidencia.

Con eso, Claude puede clasificar cada punto como sólido, dudoso o no respaldado.

Revisión de respuestas

Haz una segunda pasada centrada solamente en errores, omisiones y frases excesivamente seguras.

Luego pide una tercera revisión con enfoque inverso: que intente refutar sus propias conclusiones. Este hábito reduce respuestas aparentes, pero poco fiables y ordena mejor la revisión.

¿Qué preguntas hacer para detectar errores, alucinaciones y afirmaciones débiles en textos, tareas o código?

Alucinación significa una respuesta persuasiva sin base suficiente. Para detectarla, conviene presionar con preguntas como estas: “¿Qué parte depende de una suposición?”, “¿Qué dato necesita fecha o fuente?”, “¿Qué objeción haría un experto?” y “¿Qué línea de este código puede fallar y por qué?”.

Esto te permite obligar al modelo a justificar en lugar de adornar.

También puedes cambiar el formato, para lo que primero puedes pedir una explicación normal y luego una tabla con afirmación, evidencia, riesgo y acción sugerida.

Si la idea no se sostiene en ambos formatos, suele existir una debilidad real. Este principio también aparece en asistentes con supervisión humana, donde la rapidez de la IA se combina con criterio experto.

Límites de Claude al verificar información

Claude sigue siendo un modelo probabilístico. Anthropic reconoce que puede ofrecer respuestas incorrectas o engañosas, es decir, alucinaciones, especialmente cuando falta contexto o actualidad en los datos.

Por eso, un texto bien redactado no equivale a una comprobación de hechos. Ese límite debe estar presente en cualquier uso serio de la herramienta.

Cuando el prompt es ambiguo, el documento está incompleto o la tarea mezcla varios objetivos, la revisión pierde precisión. Además, Claude no sustituye auditorías legales, médicas, financieras ni evaluaciones académicas formales.

Errores comunes que debes evitar al confiar en esta IA

Los errores comunes que debes evitar al confiar en Claude son los siguientes:

- Pedir una verdad final en una sola consulta.

- No exigir evidencia.

- Aceptar fechas, cifras o nombres sin contraste.

- Tratar cómo hacer un detector de mentiras con Claude como si sirviera para validar emociones, testimonios o intención de engaño.

- Usar órdenes vagas, como “dime si esto es verdad”.

Esa instrucción no define alcance ni criterio mínimo. Es mejor pedir comparación, justificación y nivel de certeza.

Herramientas y funciones de Claude que mejoran la verificación de respuestas y el análisis documental

Las funciones más útiles son las respuestas con citas, la investigación guiada y el trabajo con material delimitado.

En este sentido, Research destaca porque realiza búsquedas encadenadas y muestra referencias fáciles de comprobar, lo que no elimina errores, pero sí mejora la trazabilidad del resultado y vuelve más transparente la revisión.

Asimismo, ayuda trabajar por proyectos y temas separados. Cuando mantienes un contexto estable, resulta más fácil comparar versiones y repetir criterios de control documental.

¿Cuándo conviene usar Claude para revisar información y cuándo necesitas validación humana externa?

Claude conviene para una primera auditoría rápida de textos, tareas, briefs, documentación técnica o código.

Esta IA acelera la detección de inconsistencias y ayuda a formular mejores preguntas. Por eso, cómo hacer un detector de mentiras con Claude tiene valor como sistema de cribado inicial.

La validación humana externa sigue siendo necesaria cuando existen consecuencias legales, sanitarias, financieras, académicas o reputacionales. También cuando faltan fuentes primarias o el resultado afecta a terceros.

En esos escenarios, esta inteligencia debe ser un apoyo, no árbitro final.

Claude es una IA que acelera la detección de errores, pero la validación crítica la deben seguir haciendo seres humanos

Comprender cómo hacer un detector de mentiras con Claude implica abandonar la idea de una máquina que descubre mentiras por sí sola. Lo eficaz es construir un proceso que contraste hechos, marque dudas y obligue a justificar afirmaciones con un método claro y repetible.

Cuando el prompt, las fuentes y los criterios están bien definidos, Claude aporta velocidad y orden. Sin embargo, la verificación crítica, la responsabilidad y la decisión final deben seguir en manos humanas.